A/B-Tests klingen einfach – bis man tatsächlich versucht, einen durchzuführen.

Sie möchten eine Überschrift für eine Push-Benachrichtigung testen, einen CTA in einer In-App-Nachricht anpassen oder sehen, ob das Timing oder der Kanal die Conversion beeinflusst. Aber anstatt ein Experiment zu starten, erstellen Sie ein Ticket, warten auf einen Sprint und verhandeln Prioritäten mit der Entwicklungsabteilung. Wenn der Test live geht, ist die gewonnene Erkenntnis bereits veraltet.

Wachstum gehört den Teams, die am schnellsten lernen. Wenn jedes Messaging-Experiment von einem Entwickler-Sprint abhängt, sinkt die Experimentiergeschwindigkeit – und damit auch die Fähigkeit eines PMM, messbare Ergebnisse zu erzielen.

In diesem Blogbeitrag zeigen wir, wie Marketer die Verantwortung für Kommunikationsexperimente übernehmen können, ohne die Codebasis der App anzufassen.

Die versteckten Kosten von entwicklerabhängigen Tests

Wenn Kommunikationstests von Entwicklungszyklen abhängen, verlieren PMMs nicht nur Zeit – sie verlieren Umsatz, Lerngeschwindigkeit und Momentum. Experimente verzögern sich, Erkenntnisse kommen zu spät und die Optimierung gerät unbemerkt ins Stocken.

Um diese Lücke greifbar zu machen, hier ein Vergleich zwischen entwicklerabhängigen Tests und Self-Service-Tests in der Praxis:

| Testart | Mit Entwicklerabhängigkeit | Autonome Tests |

|---|---|---|

| Text für Push-Benachrichtigungen ändern | 2-3 Wochen | 15 Minuten |

| 3 verschiedene CTAs testen | 2-3 Wochen + 3 separate Deploys | 15 Minuten (ein Setup) |

| Mit dem Sendezeitpunkt experimentieren | Erfordert Code-Änderungen | Automatische Zeitplanung |

| Push vs. In-App vs. E-Mail für bessere Conversions vergleichen | Mehrere Sprint-Zyklen | Einzelne Journey mit A/B-Split |

Sieht so aus, als wäre es einen Versuch wert, oder?

Die Beseitigung der Entwicklerabhängigkeit bei Kommunikationstests ist kein nettes Extra mehr. Sie ist die Grundlage für modernes, schnelles Marketing.

Schauen wir uns an, wie Teams von diesem Modell zu autonomen Kommunikationstests übergehen und was das in der Praxis ermöglicht.

Lösung: A/B/n-Tests innerhalb von Journeys (nicht im Code)

Der Durchbruch besteht nicht nur darin, Tests schneller zu machen, sondern die Abhängigkeit vollständig zu beseitigen.

Moderne Customer-Engagement-Plattformen trennen die Kommunikationslogik von der Codebasis Ihrer App. Anstatt Nachrichten fest in Ihre App zu programmieren, erstellen Sie sie in einem externen System, das Ihre App zur Laufzeit abfragt. Dieser architektonische Wandel bedeutet, dass PMMs Nachrichten erstellen, testen und optimieren können, ohne jemals auf Entwicklungsressourcen angewiesen zu sein.

Wie Journey-basierte Tests die Spielregeln ändern

Traditionelle A/B-Tests behandeln jede Nachricht als isoliertes Experiment. Sie testen Push A gegen Push B, wählen einen Gewinner und machen weiter.

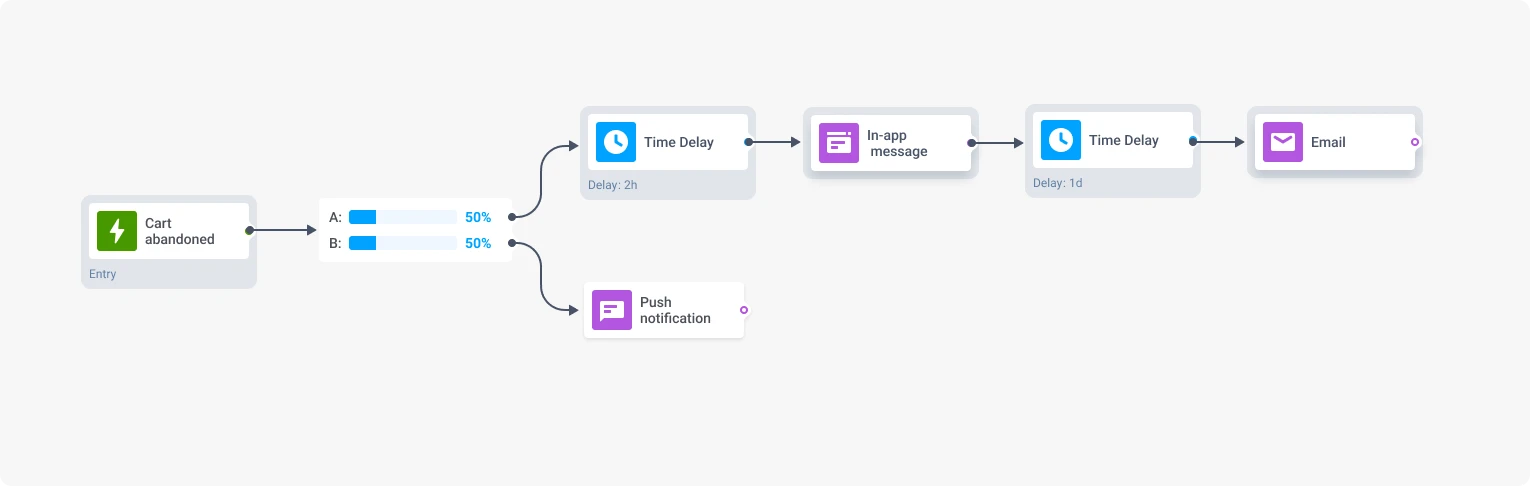

Im Customer Journey Builder können Sie den A/B/n-Split verwenden, um ganze Kommunikationsstrategien zu testen.

Anstatt zu testen: „Welche Überschrift für eine Push-Benachrichtigung funktioniert besser?“

Können Sie testen: „Sollten hochwertige Nutzer, die ihren Warenkorb verlassen, eine sofortige Push-Benachrichtigung mit einem Dringlichkeits-Framing erhalten, oder sollten sie nach 2 Stunden eine In-App-Nachricht mit einem Rabattcode bekommen, gefolgt von einer E-Mail, wenn sie nicht innerhalb von 24 Stunden konvertieren?“

Das ist nicht nur eine Variable – das sind Kanal, Timing, Text und Sequenzlogik, die alle zusammen getestet werden, um den optimalen Weg zur Conversion zu finden.

Die Plattform kümmert sich um:

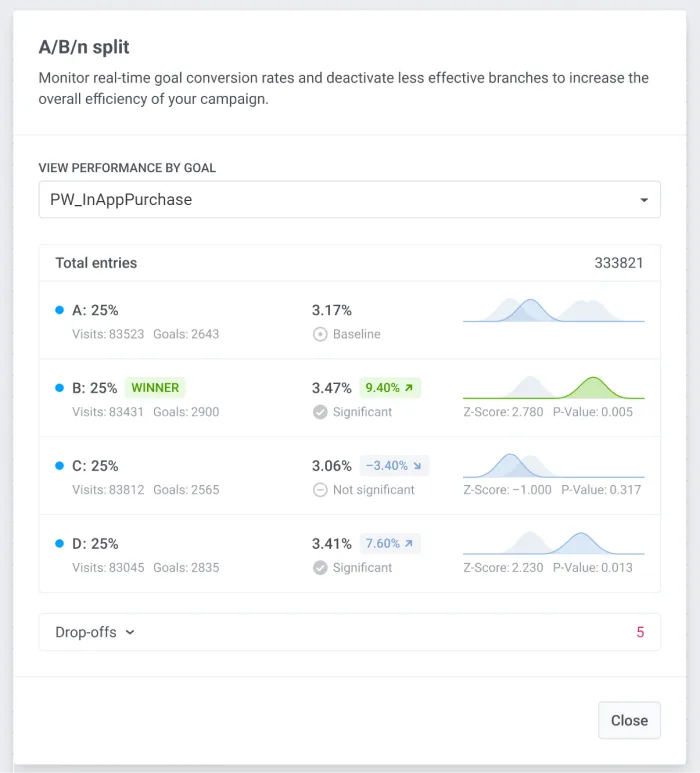

- Zufällige Traffic-Verteilung (stellt sicher, dass jede Variante eine statistisch valide Stichprobe erhält)

- Echtzeit-Performance-Tracking (Engagement-Raten, Zielerreichung, statistische Signifikanz)

- Automatische Gewinnererkennung (wenn eine Variante eine Konfidenzschwelle erreicht)

- Nahtlose Skalierung (Verlierer deaktivieren, Gewinner mit einem Klick auf 100 % skalieren)

Jede Hypothese kann validiert werden, bevor Sie sich festlegen und skalieren.

Was Sie ohne Entwicklungsarbeit testen können (und sollten)

Hier ist der volle Umfang dessen, was testbar wird, wenn Sie nicht mehr von der Entwicklungsabteilung abhängig sind:

Nachrichteninhalt und Kreativität:

- Überschriften, Textkörper, CTAs

- Ton und Stimme (dringend vs. gesprächig, vorteils- vs. funktionsorientiert)

- Personalisierungstiefe (generisch vs. namensbasiert vs. verhaltensbasiert)

- Framing des Wertversprechens (Rabatt vs. Exklusivität vs. FOMO)

- Rich Media (Bild vs. kein Bild, GIF vs. statisch, Video vs. Text)

Kanal und Format:

- Push-Benachrichtigung vs. In-App-Nachricht vs. E-Mail vs. SMS

- Einzelkanal- vs. Mehrkanal-Sequenzen

- Deep-Link-Ziele (wo Nutzer nach dem Klick landen)

Timing und Auslöser:

- Sofortige vs. verzögerte Zustellung

- Optimale Sendezeiten (morgens vs. abends, Wochentag vs. Wochenende)

- Auslöseereignisse (Warenkorbabbruch vs. Surfverhalten vs. Zeit seit dem letzten Öffnen)

- Sequenzkadenz (Nachricht 2 nach 2 Stunden vs. 24 Stunden vs. 3 Tagen)

Ergebnisse, die an echte Conversions geknüpft sind

Hier wird das Journey-basierte Testen ernst: Sie messen den Erfolg nicht an Öffnungs- oder Klickraten. Sie messen ihn an Geschäftsergebnissen.

Wenn Sie einen A/B/n-Test im Customer Journey Builder einrichten, definieren Sie Zielereignisse, die mit dem Umsatz verknüpft sind:

Purchase_CompletedSubscription_StartedPremium_UpgradeCart_CheckoutTrial_Extended

Die Plattform verfolgt, welche Variante die meisten Zielerreichungen bewirkt, berechnet die Steigerungsprozentsätze und liefert statistische Konfidenz in Echtzeit.

Das sind autonome Tests. So arbeiten moderne PMMs.

Echte No-Code-Experimente, die Sie sofort durchführen können

Theorie ist gut. Konkrete Beispiele sind besser.

Wenn Sie ein PMM oder ein Mobile Marketer mit Zugang zu einer Customer-Engagement-Plattform wie Pushwoosh sind, finden Sie hier drei Experimente, die Sie diese Woche erstellen und starten können, ganz ohne Entwicklungsaufwand.

Jedes Experiment beinhaltet: die geschäftliche Herausforderung, was getestet werden soll, wie es im Customer Journey Builder strukturiert wird und was Sie daraus lernen werden.

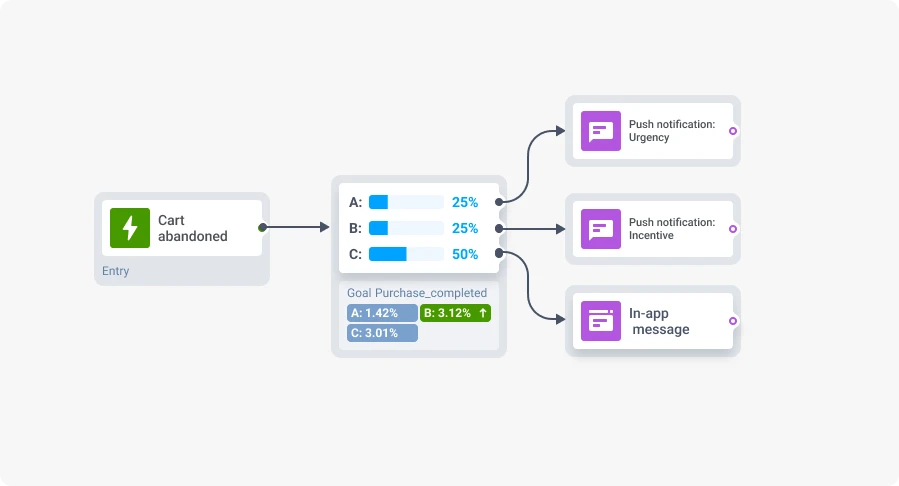

Experiment 1: Wiederherstellung bei Warenkorbabbrüchen (E-Commerce/Einzelhandel)

Die Herausforderung: 60-80 % der Nutzer, die Artikel in den Warenkorb legen, schließen den Kauf nie ab. Das ist ein massiver Umsatzverlust. Sie müssen diese Conversions wiederherstellen, wissen aber nicht, ob Dringlichkeit, Rabatte oder Beruhigung bei Ihrer Zielgruppe am besten funktionieren.

Was Sie testen: Drei verschiedene Messaging-Strategien, um Nutzer zum Abschluss ihres Kaufs zurückzubringen:

- Variante A: Dringlichkeitsbasierte Push-Benachrichtigung („Ihr Warenkorb verfällt in 3 Stunden!“)

- Variante B: Anreizbasierte Push-Benachrichtigung („Schließen Sie Ihre Bestellung ab und sparen Sie 10 %“)

- Variante C: In-App-Nachricht mit Vertrauenssignalen („Kostenlose Rücksendung/Sicherer Checkout/50.000 5-Sterne-Bewertungen“)

Einstiegstrigger: Cart_Abandoned (oder Added_to_Cart + Nutzer hat Purchase_Completed nicht innerhalb von 1 Stunde ausgelöst)

Zielereignis: Purchase_Completed

Was Sie lernen werden:

- Welcher psychologische Auslöser (Dringlichkeit vs. Anreiz vs. Vertrauen) bei Ihren Nutzern Anklang findet

- Ob Push-Benachrichtigungen oder In-App-Nachrichten für die Conversion effektiver sind

- Welches Messaging Sie auf andere umsatzkritische Journeys skalieren sollten

Zeit zum Erstellen: 30 Minuten Zeit bis zu den Ergebnissen: 5-7 Tage Keine Entwicklungsarbeit erforderlich

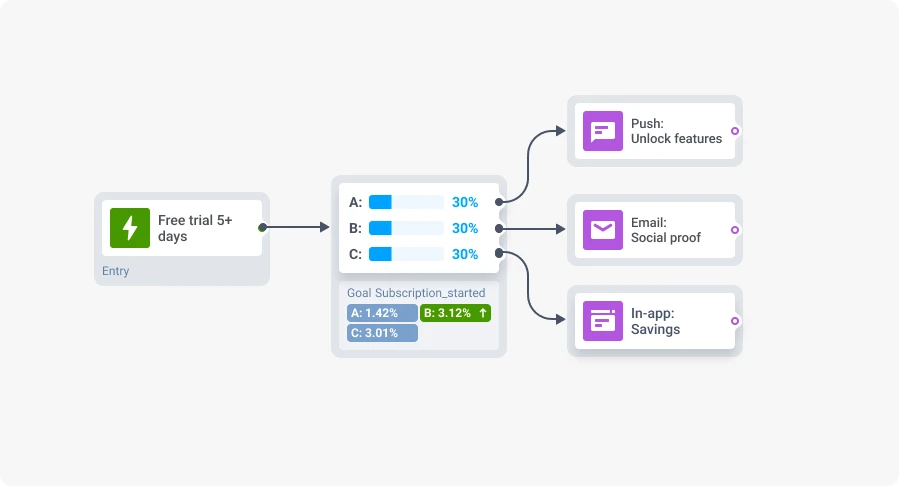

Experiment 2: Umwandlung von kostenloser Testversion in kostenpflichtiges Abo (SaaS/Fintech/Nachrichten & Medien)

Die Herausforderung: Nutzer melden sich für kostenlose Testversionen an, konvertieren aber nicht zu kostenpflichtigen Abonnements. Sie lassen sich Abonnement-Umsätze entgehen. Sie müssen verschiedene Wertversprechen testen, um zu sehen, was zu Upgrades führt.

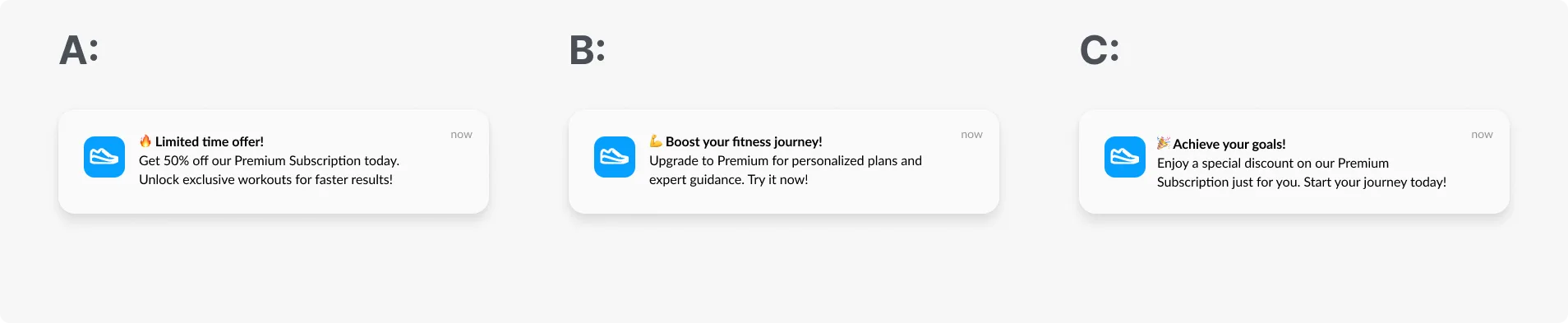

Was Sie testen: Drei verschiedene Ansätze, um Testnutzer in Premium-Abonnenten umzuwandeln:

- Variante A: Funktionsfreischaltungen („Upgraden Sie, um auf alle Premium-Funktionen zuzugreifen“)

- Variante B: Social Proof („Schließen Sie sich 100.000 Premium-Mitgliedern an“)

- Variante C: Spar-Framing („Sparen Sie 60 $/Jahr mit unserem Jahresplan“)

Plus: Kanalvergleich (Push vs. E-Mail vs. In-App)

Ereignis: Nutzer erreicht Tag 5 der 7-tägigen kostenlosen Testversion (oder ein benutzerdefinierter Meilenstein wie „Nutzer hat 3. Workout abgeschlossen“ für Fitness-Apps)

Zielereignis: Subscription_Started oder Payment_Completed

Was Sie lernen werden:

- Ob Ihre Nutzer besser auf Funktionen, Social Proof oder wirtschaftliche Anreize reagieren

- Welcher Kanal am effektivsten ist, um Abonnement-Entscheidungen zu fördern (nicht nur Engagement)

Zeit zum Erstellen: 45 Minuten (einschließlich der Erstellung von Inhalten für jeden Kanal) Zeit bis zu den Ergebnissen: 10-14 Tage Keine Entwicklungsarbeit erforderlich

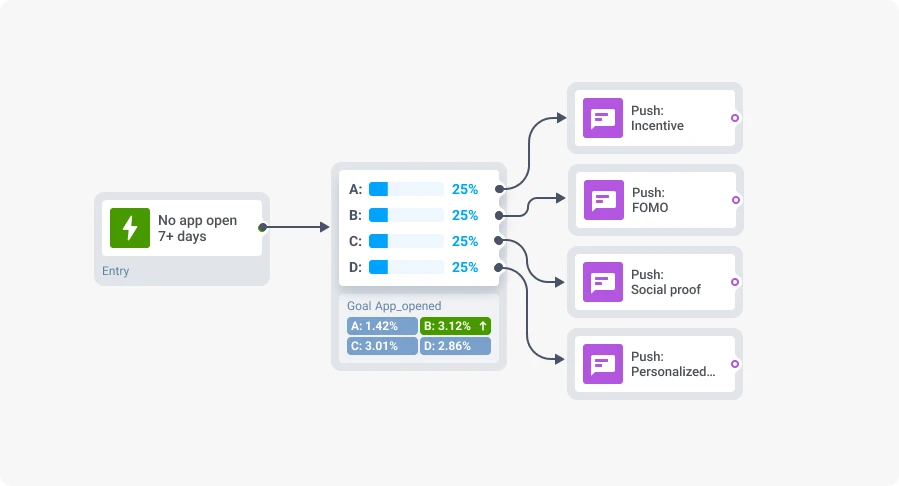

Experiment 3: Re-Engagement für inaktive Nutzer (Mobile Games/Medien/Social Apps)

Die Herausforderung: Nutzer, die Ihre App in den letzten 7+ Tagen nicht geöffnet haben, laufen Gefahr, dauerhaft abzuwandern. Sie müssen sie zurückbringen, aber generische „Wir vermissen dich“-Nachrichten funktionieren nicht. Sie möchten personalisierte Anreize vs. FOMO vs. inhaltsbasierte Aufhänger testen.

Was Sie testen: Vier verschiedene Re-Engagement-Strategien basierend auf Nutzerverhalten und -wert:

- Variante A: Anreizbasiert (Bonus-Credits/Währung)

- Variante B: FOMO-basiert (neue Inhalte/Funktionen, die sie verpassen)

- Variante C: Social Proof (Aktivitäten von Freunden/Community)

- Variante D: Personalisierte Inhalte (basierend auf ihrem früheren Verhalten)

Ereignis: Nutzer hat App_Opened in den letzten 7 Tagen nicht ausgelöst

Zielereignis: App_Opened (innerhalb von 48 Stunden nach der Nachricht)

Was Sie lernen werden:

- Wie man die Re-Engagement-Strategie nach Nutzerwert differenziert (nicht jeden gleich behandeln)

- Welche psychologischen Auslöser am besten funktionieren, um inaktive Nutzer zurückzubringen

Zeit zum Erstellen: 30 Minuten Zeit bis zu den Ergebnissen: 5-7 Tage Keine Entwicklungsarbeit erforderlich

Warum diese Experimente funktionieren

Jede dieser Journeys testet echte Marketing-Hypothesen, die sich direkt auf Geschäftskennzahlen auswirken:

- Warenkorbabbrüche → Umsatzwiederherstellung

- Testphasen-Conversion → Abonnement-Wachstum

- Re-Engagement → Kundenbindung und LTV

Und jedes davon ist:

- In weniger als einer Stunde mit visuellen Journey-Tools erstellbar

- Messbar mit echten Conversion-Ereignissen, nicht mit Vanity-Metriken

- Sofort skalierbar, sobald Sie den Gewinner identifiziert haben

- Vollständig autonom – keine Entwicklung, keine Sprints, keine Abhängigkeiten

So sieht Experimentiergeschwindigkeit aus, wenn die Testinfrastruktur mit dem Tempo des Marketings Schritt hält.

Starten Sie autonome Tests mit Pushwoosh

Während Sie zwei Wochen darauf warten, dass ein einziger Test den Entwicklungs-Backlog verlässt, führen Ihre Konkurrenten zwanzig durch.

Pushwoosh ermöglicht es mobilen Teams, autonome A/B/n-Tests innerhalb echter Customer Journeys über Push-Benachrichtigungen, In-App-Nachrichten, E-Mails, Timing und CTAs durchzuführen, ohne die Codebasis der App anzufassen.

Wenn Sie es leid sind, auf Backlogs zu warten, und bereit sind, Ihre Experimentiergeschwindigkeit zu erhöhen, ist es an der Zeit zu sehen, wie Self-Service-Tests in der Praxis aussehen.

.webp)